Comment générer des effets spéciaux (VFX) avec des outils IA

Méthode complète pour créer des VFX IA crédibles, du diagnostic de plan au compositing final sans rendu artificiel.

Comment générer des effets spéciaux (VFX) avec des outils IA sans rendu fake

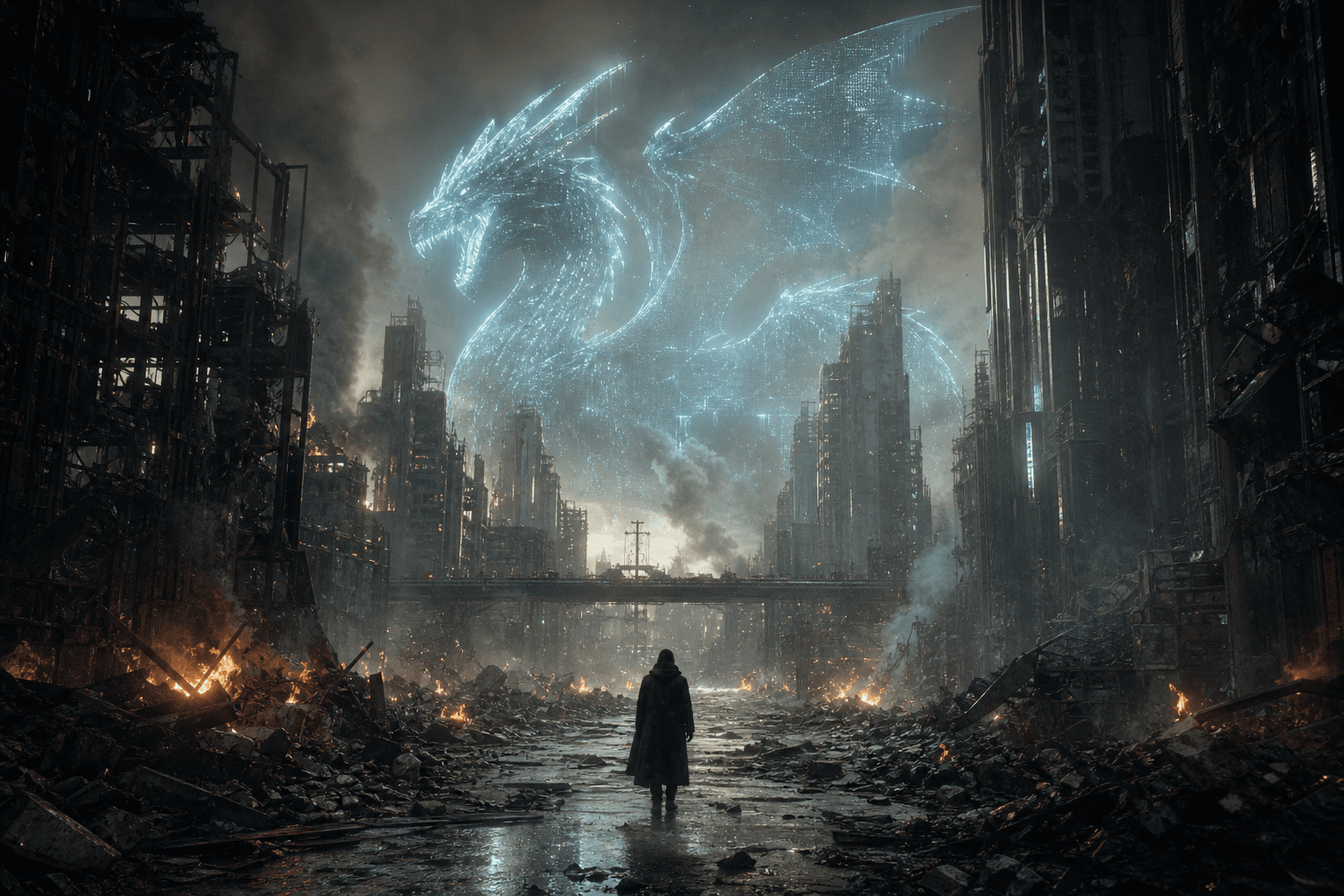

Tu ouvres ton plan, tu poses un effet IA spectaculaire, et pendant deux secondes tu te dis que c’est incroyable. Puis tu regardes en lecture réelle et tout se casse. L’effet flotte, la lumière ne match pas, le motion blur est faux, la perspective glisse, et ton spectateur sent immédiatement que c’est "collé". C’est exactement là que les débutants abandonnent les VFX IA trop vite.

Je vais être direct. Les outils IA ne remplacent pas la logique VFX. Ils accélèrent certaines étapes, oui. Mais si tu ne cadres pas ton plan comme un superviseur, tu fabriques juste une démonstration technique. Le vrai objectif est ailleurs: intégrer un effet spécial qui disparaît dans la scène et sert la narration.

Dans ce guide, on va travailler comme en production réelle: diagnostic du plan, génération en passes, compositing obligatoire, contrôle timeline, et validation multi-support. Tu vas aussi voir les erreurs qui coûtent des heures et la méthode pour les corriger rapidement sans dégrader toute la séquence.

Core concepts: ce qui rend un VFX IA crédible

Un bon VFX n’est pas "impressionnant", il est plausible. Quand l’effet attire l’attention sur lui-même au lieu de renforcer l’histoire, c’est perdu. En IA, ce piège est encore plus fréquent parce que les rendus bruts peuvent être visuellement séduisants mais physiquement incohérents.

Le premier pilier est la cohérence lumière. Direction, dureté, température, intensité, diffusion. Si ton effet lumineux ne respecte pas la scène source, l’oeil le rejette instantanément. Même un rendu 4K "propre" paraît faux si les ombres partent dans une direction impossible.

Le deuxième pilier est la cohérence spatiale. Perspective, échelle, parallaxe, profondeur de champ, relation au sol et aux objets. Les moteurs IA inventent parfois des détails superbes mais oublient ces fondamentaux. C’est pour ça qu’un compositing sérieux reste obligatoire.

Le troisième pilier est la texture temporelle. Le plan doit vivre en mouvement, pas en image fixe. Un effet peut sembler parfait sur une frame et vibrer au playback. C’est ce fameux effet "pompé" ou "flottant" qui trahit les VFX IA débutants.

Le quatrième pilier est la hiérarchie narrative. Un effet doit servir un moment précis: révéler, amplifier, corriger, ou styliser. Si tu génères "pour faire wow", tu surcharges la scène. Le spectateur ressent une rupture d’intention.

Le cinquième pilier est la gestion du niveau de détail. En VFX IA, trop de détail peut nuire autant que pas assez. Pourquoi ? Parce que le plan source porte déjà une signature optique et de compression. Si l’effet est plus détaillé que le monde qui l’entoure, il devient visuellement étranger. Une règle de terrain fonctionne très bien: l’effet doit sembler issu de la même caméra et du même pipeline que le reste de la scène.

Le sixième pilier est la robustesse de production. Tu dois pouvoir refaire un plan rapidement si une modification arrive tardivement, ce qui arrive presque toujours. Un workflow fragile, non documenté, sans versions intermédiaires, te bloque au pire moment. Les créateurs qui montent en gamme ne sont pas ceux qui trouvent un rendu "magique" une fois. Ce sont ceux qui peuvent le reproduire de manière fiable sous contrainte.

Pour verrouiller cette cohérence globale entre image générée, mise en scène et continuité, notre guide sur les erreurs de raccord film IA t’aidera à éviter les cassures qui sabotent la crédibilité.

| Type de VFX IA | Usage principal | Niveau de risque | Erreur fréquente | Correctif prioritaire |

|---|---|---|---|---|

| Cleanup / correction | Retirer éléments parasites | Faible à moyen | texture repeinte trop lisse | réintroduire grain et détail local |

| Extension de décor | Agrandir espace de scène | Moyen | perspective non cohérente | recalage géométrique + masques |

| Effet énergétique | Accent dramatique | Élevé | lumière non intégrée | relight + interaction environnement |

| Remplacement d’objet | Prop ou accessoire narratif | Moyen à élevé | scale incohérente | tracking précis + ombres de contact |

The trench workflow: méthode terrain VFX IA pas à pas

Avant toute génération, clarifie l’objectif exact du plan. Correctif discret ? Effet narratif central ? Stylisation assumée ? Ce choix détermine ton niveau de précision et le temps que tu peux investir. Sans objectif clair, tu vas multiplier les essais sans savoir quand arrêter.

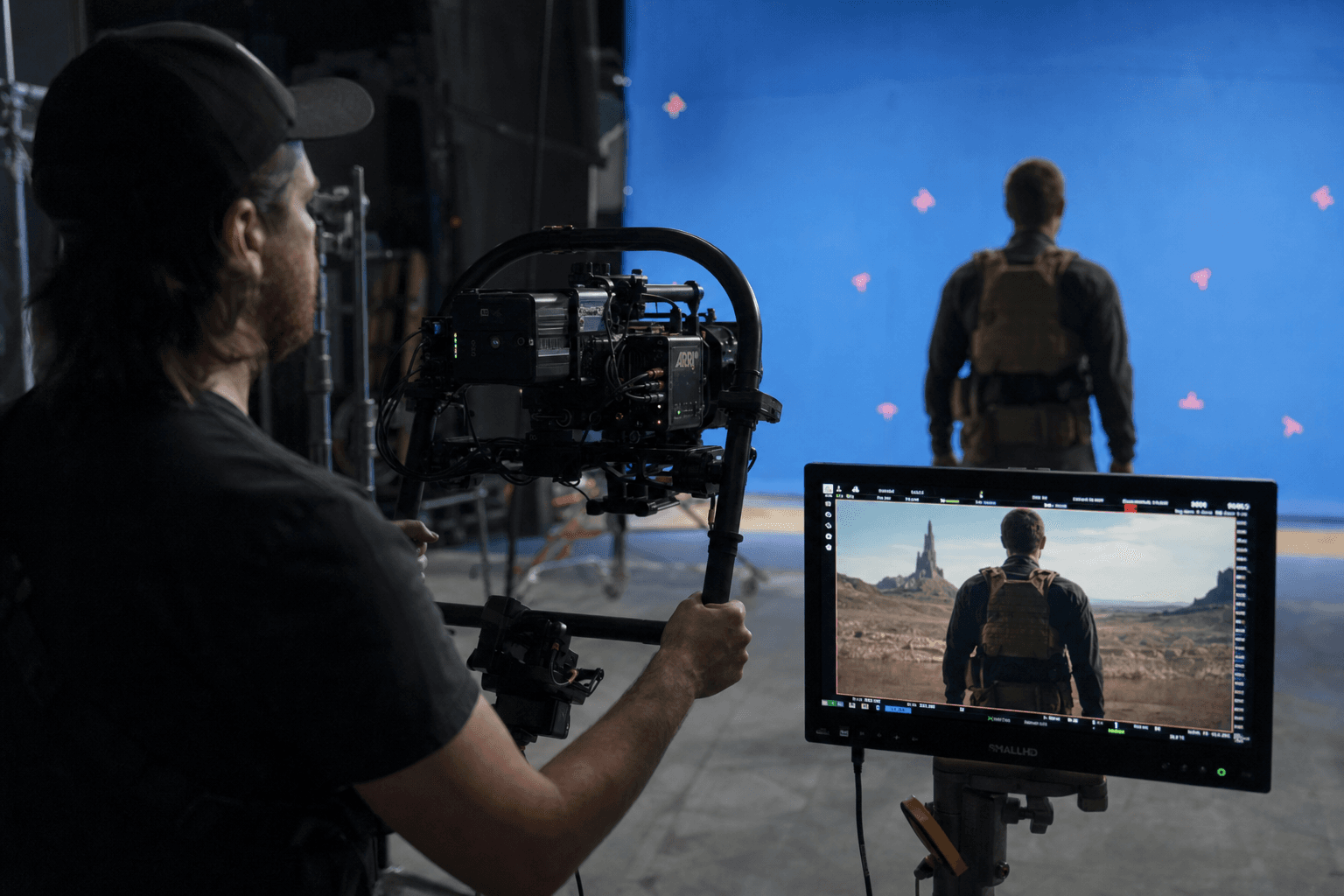

Ensuite, prépare ton plan source. Stabilisation si nécessaire, nettoyage basique, exposition cohérente, et, surtout, export dans un format qui conserve assez d’information pour le compositing. Beaucoup de déceptions viennent de sources trop compressées.

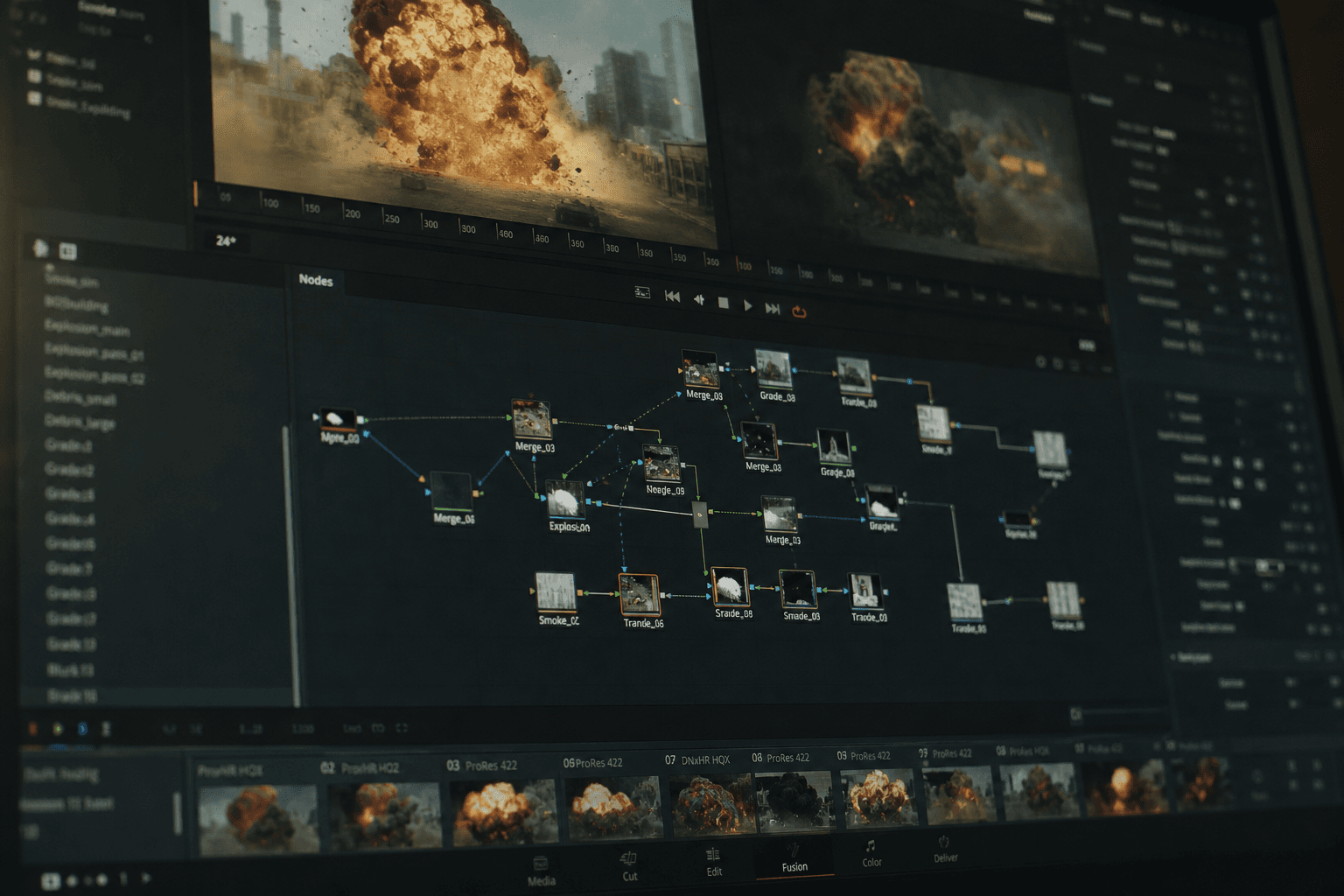

Troisième étape, génère en passes. Une pass structurelle (forme, volume, placement), une pass style (texture, détail), une pass intégration (interaction lumière/mouvement). Le mode "tout en un" donne rarement un résultat fiable en production.

Quatrième étape, compose dans la timeline réelle. Tu vérifies le raccord avant/après plan, la lisibilité de l’effet, et son impact émotionnel. Un VFX validé en preview isolée peut ruiner le rythme d’une séquence complète.

Cinquième étape, prépare dès le départ une voie de repli technique. Une version plus simple, moins ambitieuse visuellement, mais ultra stable. Cette version te sauve en livraison quand un plan refuse de converger ou quand un changement client arrive à la dernière minute. C’est une habitude de production qui évite les nuits blanches inutiles.

Étape 1: diagnostiquer le plan comme un superviseur VFX

Lis le plan en boucle et note les contraintes physiques. D’où vient la key ? Où sont les zones de contraste fort ? Quels objets doivent interagir avec l’effet ? Quelle est la direction de mouvement caméra ? Ce diagnostic prend cinq minutes et t’épargne des heures de correction.

Classe ensuite le plan selon sa sensibilité. Gros plan visage avec interaction lumineuse, plan large environnement, plan mouvement rapide, plan nocturne bruité. Chaque catégorie demande un niveau de prudence différent. Le même preset ne marche pas partout.

Définis aussi ce que tu ne toucheras pas. Visages principaux, éléments de marque, zones déjà valides. Les débutants modifient trop de zones à la fois et perdent la stabilité du plan original.

Pour conserver une direction visuelle cohérente pendant ce diagnostic, notre guide sur le montage vidéo assisté par IA donne une bonne grille de décision plan par plan.

Étape 2: générer l’effet en passes courtes et contrôlées

Commence par une pass de placement. Pas de détail, juste position, taille, interaction spatiale. Si cette base est fausse, aucune couche de style ne sauvera le plan. C’est l’erreur la plus coûteuse en temps.

Ajoute ensuite une pass texture/détail. Ici, tu règles matière, intensité visuelle, micro-détails. Reste conservateur au départ. Les détails "impressionnants" deviennent vite du bruit en mouvement.

Troisième pass, interaction avec la scène. Ombres, rebonds lumineux, occlusions, motion blur local. C’est cette couche qui fait la différence entre "effet collé" et effet intégré.

Garde un versioning strict: sc05_pl012_vfx_struct_v1, puis style_v2, puis integr_v3. Si tu ne peux pas revenir proprement à une base stable, tu vas perdre le contrôle du pipeline.

💡 Frank's Cut: si une pass "wow" te plaît mais casse la cohérence lumière, supprime-la sans hésiter. Le spectateur choisit toujours la plausibilité contre la démonstration.

Étape 3: compositing obligatoire pour faire disparaître l’effet

Le compositing est la zone où ton VFX devient crédible. Tu harmonises exposition, teinte, contraste local, profondeur, grain, et flou de mouvement. Sans cette étape, même un bon rendu IA reste visiblement artificiel.

Travaille les bords en priorité. C’est là que les faux raccords apparaissent. Un edge trop net ou trop flou trahit immédiatement l’incrustation. Utilise des masques progressifs et vérifie en lecture réelle.

Traite aussi l’interaction sol/objet. Ombre de contact, réflexion locale, déformation légère si nécessaire. Ces micro-signaux racontent la présence physique de l’effet dans la scène.

Si ton plan comporte des visages ou dialogues, coordonne ton compositing avec la lisibilité audio et la performance. Un effet trop actif peut détourner l’attention de la réplique clé. Sur cet axe, notre guide voix-off et doublage IA aide à garder la hiérarchie narrative.

Pense également à l’intégration colorimétrique globale. Un effet correctement placé peut rester faux si son comportement chromatique ne suit pas la scène, notamment dans les basses lumières et les hautes lumières écrêtées. Ajuste localement les zones critiques au lieu de pousser un grade uniforme. Cette finesse évite le rendu "patch" très courant en VFX IA débutant.

Enfin, garde une discipline de preview. Travaille avec des fenêtres de contrôle fixes: 100 pour cent, 50 pour cent, plein écran lecture réelle. Tu détecteras ainsi les problèmes qui n’apparaissent que dans certains modes d’affichage. Cette habitude simple améliore énormément la qualité perçue avant export.

Étape 4: validation finale en timeline et en diffusion réelle

Regarde d’abord le plan isolé. Puis regarde les plans avant et après. Ensuite visionne la séquence complète. Tu dois valider la continuité, pas seulement la qualité locale. Beaucoup d’effets "propres" échouent à cette étape.

Fais un test multi-support: écran principal, laptop, smartphone. Les artefacts de bord, le banding et les sur-contrastes apparaissent différemment selon la compression et la taille d’affichage.

Prends une pause de 20 à 30 minutes, puis reviens à froid. Ton oeil habitué a tendance à ignorer les défauts évidents en fin de session. Cette relecture est l’un des meilleurs outils qualité que tu puisses appliquer.

Valide enfin la version "safe" et la version "ambitieuse". Garde les deux. En deadline réelle, la version safe te protège. La version ambitieuse te permet d’apprendre sans risquer la livraison.

[🎥 WATCH: Check out this breakdown on the Business Dynamite YouTube channel: https://www.youtube.com/@BusinessDynamite - Specifically look at the segment on AI VFX compositing and realism checks]

Troubleshooting: ce que les débutants cassent le plus en VFX IA

Erreur numéro un, effet trop net par rapport au plan source. Le rendu paraît "HD" mais déconnecté. Correction: harmoniser texture, bruit, et micro-flou local pour matcher la caméra d’origine.

Erreur numéro deux, lumière incohérente. L’effet éclaire à gauche alors que la scène est key droite. Correction: relight local, correction d’ombre, et baisse d’intensité jusqu’à plausibilité.

Erreur numéro trois, échelle instable en mouvement. L’objet VFX semble gonfler ou flotter. Correction: tracking plus propre, points de référence fixes, et validation par repères de perspective.

Erreur numéro quatre, compositing insuffisant. L’effet est bon mais reste collé. Correction: bords, occlusions, interaction sol, reflets, grain partagé.

Erreur numéro cinq, surtraitement couleur. Le plan final devient saturé ou "HDR agressif". Correction: revenir à une base neutre, puis pousser subtilement.

Erreur numéro six, oublier la narration. L’effet prend la place du personnage ou de l’action principale. Correction: réduire présence et recentrer l’attention sur le point de récit.

Erreur numéro sept, ne pas anticiper la compression plateforme. Un effet finement intégré peut se casser après encodage social, avec apparition de banding ou de macroblocs dans les zones denses. Correction: faire un export test intermédiaire vers la plateforme cible et corriger avant livraison finale.

Erreur numéro huit, absence de revue externe rapide. Quand tu restes seul trop longtemps sur un plan, ton oeil s’habitue. Correction: demander un retour court à une personne qui n’a pas vu le process. Si elle remarque l’effet en premier, c’est souvent qu’il faut encore l’intégrer.

Pour cadrer ta pratique avec des bases fiables, travaille avec les docs Blender Compositing, Nuke resources et les notions VFX de Academy Color Encoding System. Ces références t’aident à dépasser la logique "preset".

💡 Frank's Cut: un VFX réussi est souvent celui que personne ne remarque. Si on parle de l’effet avant de parler de la scène, c’est rarement bon signe.

FAQ: questions clés pour générer des effets spéciaux IA crédibles

-

Quel outil IA VFX choisir quand on débute complètement ?

Choisis un outil qui te permet de faire des retakes rapides et des exports propres, pas celui qui promet l’effet le plus spectaculaire en démo. Au début, tu as besoin de contrôle et de répétabilité. Vérifie la stabilité sur plusieurs plans, la compatibilité avec ta timeline et la qualité des corrections locales. Un outil trop complexe peut ralentir ton apprentissage, mais un outil trop simplifié peut t’enfermer dans des rendus génériques. Le bon compromis est celui qui te laisse progresser sans casser ton pipeline montage. -

Pourquoi mon VFX semble propre en pause mais faux en lecture ?

Parce qu’un VFX se juge en mouvement. En image fixe, ton cerveau accepte beaucoup d’approximations. En lecture, il détecte immédiatement les incohérences de tracking, de motion blur, de bords et de lumière. C’est pour ça qu’il faut toujours valider en timeline complète, avec plans voisins. Utilise des boucles courtes pour identifier précisément le moment où ça casse. Ensuite corrige localement au lieu de relancer un rendu complet. Cette discipline te fait gagner un temps énorme et améliore rapidement la crédibilité. -

Faut-il faire les VFX avant ou après le montage ?

Fais un montage narratif solide d’abord, puis les VFX sur plans verrouillés ou quasi verrouillés. Si tu lances des VFX lourds sur un montage encore instable, tu vas jeter une partie du travail. L’approche efficace consiste à identifier les plans critiques, créer des proxies VFX légers pour valider l’intention, puis finaliser les effets une fois la structure confirmée. Ce workflow protège ton temps et ton budget machine. En production réelle, c’est souvent la différence entre un projet terminé et un projet qui dérive. -

Comment éviter l’effet "collé" sur les bords ?

L’effet collé vient souvent d’une combinaison de contours trop nets, manque d’occlusion, et texture non harmonisée. Commence par adoucir intelligemment les edges selon la profondeur et le mouvement. Ajoute ensuite des interactions locales: ombre de contact, légère réflexion, grain partagé. Vérifie en zoom 100 pour cent puis en lecture normale, car un edge peut paraître bon dans un mode et mauvais dans l’autre. Enfin, teste sur plusieurs écrans. Les défauts de bord ressortent particulièrement sur mobile compressé. -

Combien de passes faut-il pour un VFX IA propre ?

En général, trois passes suffisent pour la majorité des cas: placement structurel, style/détail, et intégration compositing. Certaines scènes complexes demandent plus, mais commencer avec cette structure te donne déjà un cadre solide. Le piège est de vouloir tout faire en une seule génération. Tu gagnes du temps au départ, mais tu en perds énormément en correction. Les passes séparées te permettent d’isoler les problèmes et de corriger précisément sans détruire ce qui fonctionne déjà. C’est une logique de production pro. -

Comment garder la cohérence entre plusieurs plans VFX d’une même scène ?

Crée une mini bible technique de séquence: direction lumière, température, contraste cible, niveau de grain, comportement du mouvement. Référence cette bible à chaque plan au lieu de régler "au feeling". Utilise aussi un plan témoin validé pour comparer les nouveaux rendus. Sans repère, les dérives s’accumulent vite. La cohérence se joue sur des micro-différences répétées. Si tu verrouilles ces paramètres tôt, tu réduis fortement l’effet patchwork qui trahit beaucoup de projets IA. -

Peut-on faire des VFX IA crédibles sur une machine moyenne ?

Oui, si ton workflow est malin. Travaille en segments courts, utilise des proxies pour valider l’intention, puis rends en qualité finale uniquement les plans validés. Évite les cycles complets en haute qualité à chaque retake. Tu peux aussi prioriser les plans à fort impact narratif et simplifier les plans secondaires. La machine compte, mais la méthode compte davantage. J’ai vu des setups modestes livrer des résultats très propres grâce à une discipline stricte de versioning et de validation. -

Quelle routine rapide appliquer cette semaine pour progresser en VFX IA ?

Fais un sprint de 90 minutes: 20 minutes de diagnostic et brief, 30 minutes de génération en trois passes sur un seul plan, 25 minutes de compositing ciblé, 15 minutes de validation multi-support. Puis répète sur un deuxième plan d’un type différent. L’objectif n’est pas de faire "beaucoup", mais d’installer un protocole reproductible. En quelques sessions, tu vas réduire drastiquement les erreurs classiques et gagner en confiance sur des effets plus ambitieux.

Cas réel: trois scénarios VFX IA de terrain

Scénario 1, extension de décor pour un court métrage urbain. Le plan source montrait une rue courte, peu cinématographique, avec un horizon bouché. L’objectif était d’étendre la profondeur de décor sans attirer l’attention sur la manipulation. La pass structurelle a défini la perspective et les volumes principaux. La pass style a ajouté matières cohérentes avec le quartier. La pass intégration a réglé les interactions lumière et grain. Résultat final: le plan paraît plus ambitieux, sans signal évident de génération artificielle. Le secret n’était pas l’effet spectaculaire. C’était la cohérence silencieuse.

Scénario 2, effet énergétique discret sur une séquence de tension. Le client voulait un signal visuel de danger, mais sans basculer dans l’esthétique clip. En première tentative, l’effet était trop lumineux et "jeu vidéo". On a réduit l’intensité, ajouté une interaction lumineuse locale minimale, puis renforcé le son au lieu de pousser l’image. Ce rééquilibrage a produit un résultat bien plus crédible. Leçon importante: en VFX IA, l’image et le son doivent coopérer. Si tout est porté par le visuel, tu risques l’excès.

Scénario 3, nettoyage d’éléments parasites sur une scène dialoguée. Un reflet moderne et une signalétique hors époque cassaient l’univers. L’IA a fait le cleanup rapidement, mais les premières versions lissaient trop les textures de mur. En compositing, on a réinjecté grain, micro-contraste, et irrégularités de surface. La correction est devenue invisible en lecture. Ce type de travail rapporte énormément: ce ne sont pas des effets "show-off", mais ce sont eux qui protègent la crédibilité globale du film.

Checklist finale avant publication d’un plan VFX IA

Avant de livrer, applique une checklist stricte. Tu vérifies d’abord la cohérence lumière: direction, température, intensité. Ensuite la cohérence spatiale: perspective, taille, ancrage au sol, relation aux objets. Puis la cohérence temporelle: stabilité en mouvement, absence de flicker parasite, qualité des transitions.

Tu contrôles ensuite l’intégration matière: texture, grain, netteté relative, compression. Une zone trop propre ou trop détaillée doit être ramenée dans la signature visuelle du plan source. Cette étape est souvent négligée, alors qu’elle influence fortement la perception de réalisme.

Passe ensuite au contrôle narratif. Est-ce que l’effet sert bien le moment de scène ? Est-ce qu’il attire trop l’attention ? Est-ce qu’il protège ou perturbe la performance des acteurs ? Ce filtre narratif évite les plans techniquement réussis mais dramatiquement contre-productifs.

Termine avec un test diffusion réelle. Export test, lecture mobile, lecture laptop, lecture écran principal. Si la version tient sur ces trois contextes, tu as une base solide. Si un défaut apparaît sur un seul support, corrige avant publication. Cette rigueur fait la différence entre un rendu "demo" et un rendu livrable.

Continuer la lecture

Comment améliorer un rendu moyen en rendu pro

Un plan vidéo IA correct ne suffit pas sur un écran sérieux : diagnostic par couches, chaîne de post solide, upscaling maîtrisé et discipline de rejet pour passer d'un rendu moyen à un rendu pro sans magie ni promesses trompeuses.

Comment transformer une vidéo IA en publicité premium

Méthode complète pour transformer une vidéo IA en publicité premium : cadre créatif orienté conversion, cohérence visuelle disciplinée, post-production sérieuse et contrôle qualité média comme une agence. Le mot-clé transformer vidéo IA publicité premium devient ici une check-list exécutable.

Comment mixer audio et image pour un rendu cinéma

Mixer audio et image pour un rendu cinéma sur vidéo IA : hiérarchie sonore, stems, dynamique, spatialisation, calibration avec l’étalonnage et livraison sans fatigue ni sensation « démo ».