Flux vs SDXL : quelle IA choisir pour des images réalistes

Comparaison terrain, cas d’usage, VRAM, et comment décider en vingt minutes de tests.

Tu lis un thread qui crie victoire pour Flux, un autre qui jure souvent que SDXL reste roi avec les bons LoRA. Tu ouvres ton portefeuille GPU, tu regardes ta VRAM, tu te demandes si tu dois tout réapprendre vite. La bonne nouvelle simple : tu n’as pas besoin d’une religion, tu as besoin d’un protocole de test vingt minutes sur ton sujet réel du jour.

Ce guide compare les deux familles sur le terrain : portrait, scène chargée, vitesse locale, passage vers la vidéo, et surtout habitudes de fichiers qui survivront au prochain modèle sorti mardi prochain. Trois profils pour ancrer la discussion. Thomas à Nantes fait des portraits corporate : il voulait des yeux stables et des vestes en laine crédibles, il a comparé les deux moteurs sur le même brief avant de choisir un pipeline. Inès à Dakar produit des illustrations de lieux urbains : elle valorisait l’écosystème ComfyUI et les centaines de checkpoints SDXL. Roberto à Barcelone prépare des keyframes pour de la vidéo : il lui fallait des PNG propres, des métadonnées de focale, et une chaîne reproductible. Aucun des trois n’a « raison » en absolu : ils ont aligné l’outil sur une contrainte précise, budget GPU, liberté de graphe, ou livrable animé.

Pour le contexte historique et technique de la famille SDXL, l’article Stable Diffusion sur Wikipédia reste une base lisible. Flux, lui, appartient à une vague plus récente de modèles, souvent évalués sur la cohérence des matières et des scènes complexes.

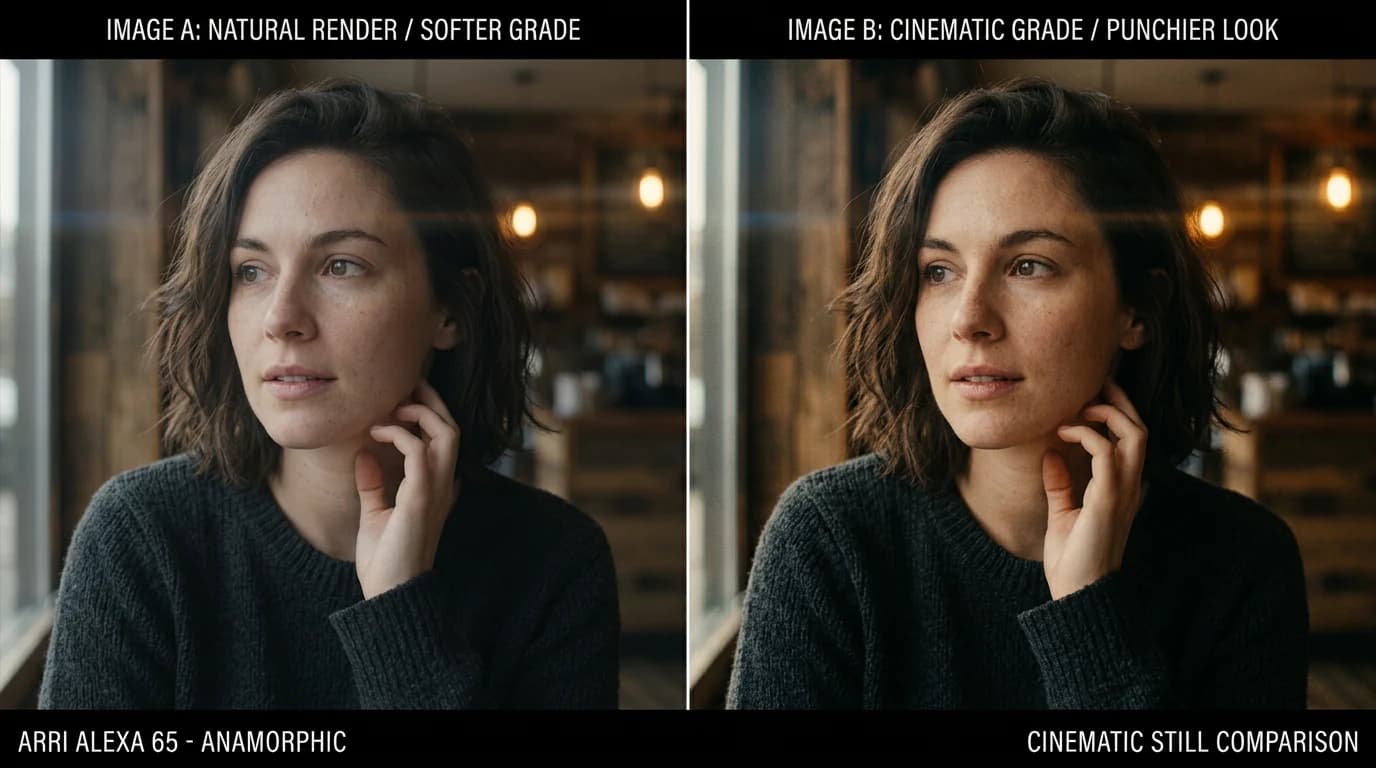

Ce que « réaliste » veut dire dans ce comparatif

Réaliste ne veut pas dire « ressemble à une photo Instagram filtrée ». Ici, ça veut dire : géométrie crédible sur les objets proches, lumière avec une direction identifiable, peau qui ne ressemble pas à de la cire, et profondeur de champ qui ne coupe pas le sujet comme un collage. Si ton projet est volontairement stylisé, le comparatif change de critères : tu cherches alors la cohérence du style, pas la photocrédibilité.

Fixe une échelle de notation privée sur trois points : mains et dents, tissus, reflets. Note chaque test de 0 à 2. Après dix tests, tu vois des tendances sans te laisser impressionner par une seule image chanceuse.

Le test AB honnête en vingt minutes

Tu prépares un seul prompt court structuré, pas un pavé copié sur Discord. Tu fixes ratio, résolution de base, et tu notes tout dans un fichier texte.

35mm spherical, eye level, medium shot, man early 30s, stubble,

worn denim jacket, rainy street at dusk, neon reflections on wet asphalt,

single key from shop window, cool fill from sky, natural skin texture,

shallow depth of field, no plastic skin, film grain fine

Minute 0-5 : tu génères avec ton meilleur setup SDXL habituel, checkpoint + LoRA si tu en utilises, guidance au milieu de la plage, steps au premier palier stable.

Minute 5-10 : tu génères avec Flux ou l’implémentation disponible chez toi, mêmes dimensions, prompt identique ou équivalent si l’outil impose une syntaxe.

Minute 10-15 : tu compares au zoom sur mains, dents, transitions tissu, et cohérence des reflets au sol.

Minute 15-20 : tu décides non pas « lequel est meilleur en général », mais lequel ment le moins sur ton sujet du jour. Tu archives les deux PNG avec un nom de fichier qui contient la date et le moteur.

Variante test « intérieur »

Duplique la session avec un prompt intérieur fenêtre nord, practical au fond, même personnage. Les moteurs ne réagissent pas toujours comme en extérieur néon. Note séparément les scores mains et tissus. Si l’intérieur favorise SDXL et l’extérieur Flux sur ton stack, tu as gagné une carte de route : tu ne choisis plus au hasard selon l’heure.

Variante test « texte dans l’image »

Si ton usage inclut une enseigne lisible, ajoute une ligne avec le texte exact et observe lequel des deux moteurs respecte le mieux la typo sans déformer l’environnement. Ce test élimine vite les illusions sur la « polyvalence ».

Astuce pro : si tu changes trois variables entre les deux tests, tu compares tes erreurs, pas les moteurs.

Pour éviter le rendu plastique quel que soit le moteur, comment générer des images IA photoréalistes sans effet plastique complète cette page.

Portrait : peau, yeux, et stabilité

Sur portrait serré, la bataille se joue souvent sur la transition ombre lumière et le détail des yeux sans brillance de poupée. SDXL avec un bon checkpoint portrait et parfois un LoRA peau peut être extrêmement flexible. Flux est souvent cité pour des transitions douces sur les matières complexes.

Tu testes avec mains hors champ d’abord, puis une version avec mains visibles en second plan flou. Si les mains cassent sur les deux, le problème est géométrique (focale, cadrage) avant d’être « Flux vs SDXL ».

Pour le grain et la finition après coup, comment ajouter du grain cinéma sur une image IA s’applique aux deux pipelines.

Scène chargée : objets, profondeur, et lisibilité

Quand le cadre contient vitrine, rue, passants suggérés, véhicules, la hiérarchie visuelle devient le critère. Tu regardes si l’arrière-plan s’effondre en boue ou si les reflets au sol restent cohérents avec les sources.

SDXL peut briller avec des workflows node-based où tu contrôles étape par étape. Flux peut simplifier certaines transitions si ton interface l’intègre bien. Encore une fois, ton décor décide plus que le badge marketing.

Si la profondeur de champ ment, comment générer une scène réaliste avec profondeur de champ aide à corriger le prompt avant de blâmer le moteur.

Tableau : critère, SDXL, Flux, note terrain

| Critère | SDXL | Flux | Note |

|---|---|---|---|

| Écosystème LoRA | très large | en croissance | dépend de ton besoin |

| Workflows custom | ComfyUI mature | selon intégration | documente tes nodes |

| Portrait peau | très bon avec bons poids | souvent très bon | test AB |

| Scène complexe | variable | souvent fort | test AB |

| Reproductibilité | seed + checkpoint | seed + version | archive tout |

| VRAM | optimisable | selon quant | regarde le batch réel |

Astuce pro : le meilleur moteur est celui que tu sais documenter. Un modèle moyen avec un fichier

readmepropre bat un géant mystérieux.

VRAM, vitesse, et itérations

Tu itères à résolution modeste, tu upscales ou tu regénères haut quand la composition est figée. Cette règle vaut pour les deux mondes. Si ton GPU suffoque, baisse la résolution, réduis le batch, désactive les previews lourdes, et garde un nombre de steps minimal pour décider, pas pour livrer.

Sur laptop, préfère des sessions courtes avec sauvegarde systématique des prompts. La VRAM est une contrainte physique, pas un jugement de valeur.

Journal de session type

À la fin de chaque soirée, écris quatre lignes : moteur, résolution, steps moyens, et une phrase sur l’échec principal (mains, reflets, boue). Au bout de deux semaines, tu lis ton journal comme un tableau de bord. Tu sauras si tu perds du temps sur le mauvais réglage ou sur le mauvais outil.

Si tu utilises ComfyUI ou équivalent, exporte une capture du graphe quand une image est validée. Le graphe vaut autant que le prompt pour la reproduction. Nomme le fichier avec le hash court du modèle si l’interface le montre.

Quand tu passes sur une file d’attente cloud, recopie dans ton fichier texte les options cochées, « safety », « refiner », ou autres cases qui modifient la sortie. Les interfaces changent sans prévenir, ton fichier texte devient ton contrat avec toi-même.

Pour le contraste et la couleur après génération, pourquoi tes images IA manquent de contraste et comment corriger évite de compenser en saturation ce qui vient du moteur.

Pour l’œil sur la lumière, cette vidéo reste utile : lumière et atmosphère.

Passage vidéo : PNG propres et métadonnées

Quelle que soit la source, exporte une version sans sharpen extrême pour la vidéo, note focale et direction de lumière dans un fichier texte à côté. Si tu livres à un monteur externe, ajoute une ligne sur le gamma attendu (sRGB habituel) et sur la présence ou non d’un grain déjà incrusté, pour éviter le double grain involontaire. Une chaîne fichier propre vaut mieux qu’un modèle brillant mal documenté.

Si tu utilises plusieurs outils, garde un dossier refs avec la frame pilote et un prompt_master.txt. La vidéo te remerciera quand il faudra matcher le grain et les hautes lumières.

Guerre des tranchées : ce que les débutants ratent, et comment réparer

Tu crois que changer de moteur remplace un mauvais brief. Tu obtiens le même néon parce que ton prompt ne nomme pas la key.

Tu copies des réglages CFG et steps d’un tutoriel sans le même checkpoint. Tu conclus que « SDXL est boueux » ou « Flux est plastique » alors que tu compares des mondes différents.

Tu montes la résolution pour cacher une composition fausse. Tu optimises des erreurs en 4K.

Tu ignores les LoRA sur SDXL par snobisme, ou tu en empiles cinq sans test. Dans les deux cas, tu perds le contrôle.

Tu n’archives pas version modèle et date. Trois mois plus tard, tu ne peux pas reproduire une image gagnante.

Tu veux tout faire dans le cloud sans budget : tu te retrouves à jongler entre files d’attente et réglages réinitialisés. Documente même les sessions cloud comme un studio.

Tu compares JPEG compressés au lieu des PNG sources. Les artefacts deviennent de « preuves » contre un moteur.

Tu installes cinq extensions le même jour, tu changes scheduler, tu actives un post-traitement automatique, puis tu conclus que « SDXL est instable ». Reviens à une config minimale documentée, ajoute une brique à la fois.

Tu crois que le meilleur modèle remplace l’étalonnage. Tu livres des verts néon sur la peau parce que tu n’as pas passé dix minutes sur une courbe commune après génération.

Astuce pro : choisis un « sujet test » fixe dans ta vie, ton café, ton chat, ton bureau, et rerun le test AB chaque fois que tu changes de gros morceau de stack. Tu vois vite la dérive.

Astuce pro : si Flux gagne sur la matière mais SDXL gagne sur le contrôle fin avec LoRA, hybride ton pipeline : génère large avec l’un, inpaint ou affiner avec l’autre si les licences et l’outil le permettent.

FAQ

Foire aux questions

Réponses rapides aux questions les plus fréquentes sur cet article.

Dois-je abandonner SDXL si Flux existe sur mon outil ?

Non sans test. Garde SDXL si ton écosystème LoRA et tes workflows sont déjà rentables. Ajoute Flux comme option sur les scènes où tu vois un gain mesuré sur tes propres prompts.

Combien de temps pour un test AB sérieux ?

Vingt minutes suffisent si tu fixes un prompt, une résolution, et une méthode de comparaison au zoom. Une heure si tu explores plusieurs checkpoints, mais note chaque variante.

La VRAM minimale, c’est quoi ?

Ça dépend de la quant, de la résolution, et du framework. Mesure avec un monitoring GPU pendant un batch réel plutôt que de croire les tableaux marketing.

Pourquoi mes résultats Flux et SDXL sont incomparables ?

Schedulers différents, prétraitements d’image, post-traitements intégrés, ou prompts légèrement transformés par l’interface. Normalise tout ce que tu peux avant de juger.

Je fais surtout du portrait, par où commencer ?

Test AB sur un portrait avec mains hors champ, puis avec mains en arrière-plan flou. Regarde yeux, texture de veste, transition nez joue. Garde le moteur qui ment le moins sur ces trois points.

Je fais surtout des décors urbains complexes ?

Test AB sur une rue humide avec reflets et enseignes. Regarde la cohérence du sol et la lisibilité du sujet. Note si tu dois simplifier le prompt pour l’un des moteurs.

Le grain, avant ou après ?

Souvent après en overlay contrôlé, parfois léger dans le prompt en plus si tu sais ce que chaque couche apporte. Voir l’article grain du site.

Puis-je préparer une image pour vidéo avec les deux ?

Oui, à condition d’exporter des masters propres, sans sharpen agressif, et de documenter focale et lumière. La cohérence vidéo dépend plus de ta discipline de fichiers que du badge sur le moteur.

Comment éviter la dépendance à un seul fournisseur cloud ?

Garde des copies locales de prompts, de seeds, et d’images sources. Exporte en PNG quand c’est possible. Si le service change de modèle, tu as une trace de ce qui a fonctionné.

SDXL est-il « fini » ?

Non en tant qu’écosystème. Les outils évoluent vite. Ton critère reste le rendu sur ton sujet et ta capacité à reproduire, pas l’étiquette de la semaine sur les réseaux.

Puis-je combiner les deux dans un même projet ?

Oui si les licences et les formats le permettent : par exemple une base décor avec le moteur qui gère le mieux la scène, puis un raffinement portrait avec l’autre. Documente les deux chaînes pour ne pas te perdre dans les couleurs et le grain différents.

Comment gérer les différences de couleur entre deux moteurs sur une série ?

Applique une courbe de référence commune en post sur toute la série, ou génère avec un prompt qui impose une balance plus neutre avant grade. Garde une still de référence sur le bord de l’écran pendant la session.

Lequel est le plus « pro client » ?

Celui qui te permet de livrer à l’heure avec une qualité stable et traçable. Les clients achètent un résultat et une méthode, pas un badge technique. Si SDXL te donne des LoRA métier irremplaçables, c’est une valeur.

Dois-je apprendre ComfyUI pour SDXL ?

Pas obligatoire, mais très utile si tu veux des pipelines reproductibles et modulaires. Si tu préfères une interface simple, choisis un frontal stable et documente quand même tes réglages à la main.

Flux consomme-t-il toujours plus de VRAM ?

Pas « toujours », ça dépend de l’implémentation, de la résolution, et des optimisations activées. Mesure sur ton matériel avec un projet type plutôt que de croire les rumeurs.

Comment savoir si mon checkpoint SDXL est pourri ?

Teste-le sur trois prompts courts que tu maîtrises. Si trois sujets différents donnent les mêmes défauts (dents, yeux, tissu), le poids est peut-être en cause. Compare avec un autre checkpoint avant d’accuser le moteur entier.

L’upscale change-t-il le verdict du test AB ?

Oui si tu upscales différemment entre les deux branches. Si tu veux comparer les moteurs, reste à la même résolution post-traitement ou upscale avec le même outil et les mêmes paramètres, sinon tu juges l’upscaler, pas le générateur de base.

Section de conformite editoriale

Suivre aussi les analyses de @BusinessDynamite pour garder une direction visuelle coherente et orientee production.

Liens internes utiles :

- /blog/comment-ecrire-prompt-cinematic-ultra-realiste-ia

- /blog/comment-structurer-video-ia-comme-vrai-film

Continuer la lecture

Comment améliorer la fluidité d'une vidéo générée

Fluidité perçue, stabilité temporelle et chaîne de production : méthode concrète pour améliorer la fluidité d'une vidéo générée sans illusion marketing ni réglages au hasard.

Comment corriger les couleurs d'une vidéo IA

Méthode complète pour corriger les couleurs d'une vidéo IA : diagnostic des défauts typiques, ordre des corrections, scopes, continuité entre plans, peau et compression mobile. Pensée pour passer du rendu « démo » à une livraison défendable.

Comment ajouter du réalisme en post-production

Après la génération vidéo IA, le réalisme se gagne en post : grade motivé, texture temporelle, mouvement modéré, son crédible, et une discipline de rejet qui transforme un clip démo en plan livrable.